- 입력 2025.03.15 15:00

0

0[ 아시아경제 ]

합스부르크(Habsburg) 가문은 600년 가까이 유럽을 지배한 왕가였습니다. 비결은 ‘결혼’이었습니다. 주변 강국과 혼맥을 형성하면서 지배권을 확립해나갔죠. 이 가문의 카를 5세는 신성로마제국 황제, 스페인왕, 독일왕, 오스트리아 대공, 네덜란드 영주 등 직함이 20개가 넘었습니다. 그의 나이는 불과 19세였죠.

이들은 왕가의 혈통을 '순수하게' 유지하려고 했습니다. 그래서 친족 간 결혼을 반복했죠. 삼촌과 조카, 사촌 간의 결혼이 매우 흔했습니다. 이는 결국 유전병으로 이어졌죠.

여러 세대에 걸친 지속적인 근친혼으로 인해 유전적 다양성이 매우 낮아졌고, 건강 문제가 나타났습니다. 카를로스 2세의 경우 심각한 신체적, 정신적 장애를 겪었습니다. 자식을 남기지 못한 채 사망하면서 스페인 합스부르크 왕가는 끝나게 되었습니다. 결혼으로 흥했다가, 결혼으로 망한 셈이죠. 유전적 다양성이 개체의 지속가능성에 얼마나 중요한지를 잘 보여주는 사례죠.

합스부르크 사례는 AI업계에서도 종종 회자되곤 합니다. 실제로 ‘합스부르크 AI’란 명칭마저 존재하죠. 문자 그대로, 합스부르크 제국이 근친혼으로 인해 붕괴된 역사적 사실에 빗대어 만들어진 용어입니다. AI 모델이 ‘합성 데이터(Synthetic Data)’에 과도하게 의존할 경우 발생할 수 있는 문제점을 지적하는 은유적 표현입니다.

빠르고 저렴한 데이터 : 합성데이터의 힘

합성 데이터란, 실제 데이터를 모방해 인공적으로 생성한 데이터입니다. 학습에 적절한 데이터가 없거나, 데이터 획득 비용이 너무 높을 때 이용할 수 있는 대안이죠.

가령 자율주행차 개발 과정에서 유용합니다. 충돌 방지를 위한 학습을 시키려면, 다양한 충돌 데이터가 필요합니다. 하지만 이런 데이터는 차선 변경, 표지판 인식 등에 비해선 그 양이 비교할 수 없을 정도로 부족할 겁니다. 발생 빈도가 확연히 적으니까요. 그럴 때 컴퓨터 시뮬레이션을 통해 가상 도로 운전을 하고 충돌 상황을 재현하면 필요한 데이터를 얻을 수 있습니다. 빠르고 저렴하죠.

실제 데이터가 부족한 특정 상황이나 희귀 케이스를 인위적으로 보강하는 전략도 가능합니다. 편향적인 데이터의 균형을 맞추는 데도 도움이 됩니다.

프라이버시 보호도 합성 데이터의 강점입니다. 실제 개인정보를 사용하지 않으면서도 유사한 특성을 가진 데이터로 AI를 학습시킬 수 있거든요. 실제 환자 기록을 바탕으로 가상의 환자 데이터를 만들거나, 실제 거래 내역을 분석해 유사한 패턴의 가상 거래 데이터를 생성할 수 있습니다.

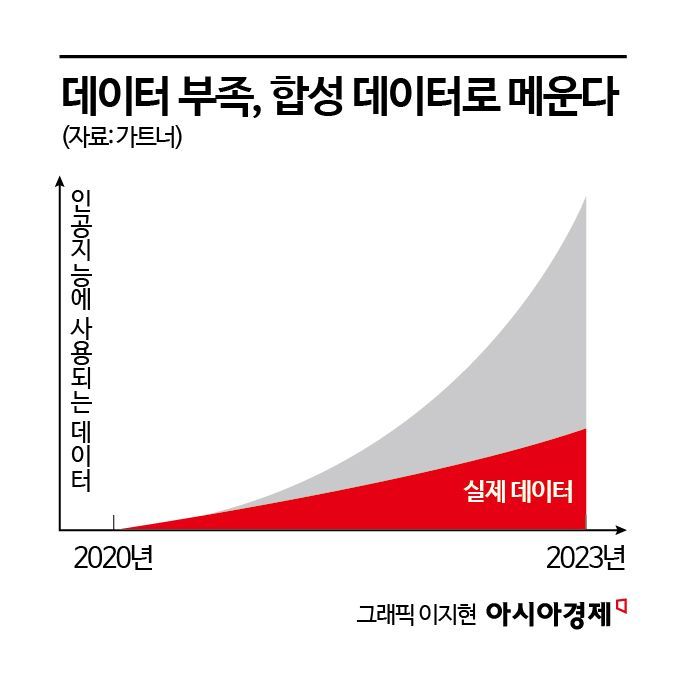

글로벌 시장조사 업체인 가트너에 따르면, 2030년경에는 AI 학습에 합성 데이터를 실제 데이터보다 더 많이 사용할 것이라고 합니다. 가트너는 “합성 데이터 없이는 고성능, 고품질 AI 개발이 불가능할 것”이라고 예측했죠.

일론 머스크가 설립한 AI 스타트업 ‘xAI’는 지난달 AI 챗봇 '그록(Grok)3'를 공개했습니다. xAI는 이날 라이브스트림으로 중계한 발표회에서 “그록3가 수학, 과학, 코딩 벤치마크 테스트에서 알파벳의 구글 제미나이, 앤스로픽의 클로드, 오픈AI의 GPT-4o를 앞섰다”고 주장했습니다.

뛰어난 성능은 주목을 받기에 충분했습니다. 머스크는 “그록3의 연산능력은 이전 버전 대비 10배가 넘는다”면서 “지구에서 가장 똑똑한 AI”라고 했죠. xAI 연구진은 “그록3가 대량의 합성 데이터 세트와 자체 오류수정, 강화학습을 통해 그록2보다 정교한 결과를 내놓는다”고 설명했습니다. 2023년 7월 회사 설립, 그해 11월 첫 '그록' 공개, 지난해 8월 '그록2'를 출시한 지 6개월 만이었죠.

이렇게 짧은 시간에 강력한 성능을 지닌 AI를 만들어낼 수 있었던 비결 중에는, xAI 연구진이 앞서 밝힌 ‘합성 데이터’가 있었습니다.

그록을 향한 물음표 : 합성 데이터의 위험성

그러나 그록3는 즉각적인 비판에 부딪혔습니다. 성능은 뛰어나지만, 그록3를 뛰어나게 만들어준 그 장점, 바로 합성 데이터가 한편으로 독이 될 수 있다는 겁니다.

영국 옥스포드대학 연구팀은 지난해 6월 국제학술지 네이처에 게재한 논문에서, 사람이 아닌 AI가 생성한 데이터로 학습한 AI의 성능은 급격히 떨어질 수 있다고 밝혔습니다. 연구진은 첫 AI 모델로 14세기 영국 교회 탑, 건축물에 대한 텍스트 정보를 만들어냈습니다. 이후 이 정보를 토대로 새로운 답변을 유도하는 등 되먹임 과정을 반복했습니다. 이 과정이 반복될수록, AI는 뜬금없는 결과물을 내놓기 시작했습니다. 중세 건축물과 관련한 이야기는 사라지고, 명령을 하지도 않았는데 외국어로 답변을 내놓는가 하면, 웬 토끼 이야기를 꺼내기도 했습니다.

연구진은 이를 ‘모델 붕괴(models collapse)’라 개념화했습니다. AI로 만들어낸 정보를 AI가 받아서 학습하는 과정을 반복하면, 결과물의 가치가 갈수록 퇴행한다는 것이죠. 호주 모내시대학의 데이터과학자 제이선 섀도스키는 이를 아예 ‘합스부르크 AI’라 명명했습니다. 합스부르크 가문이 지속적인 근친교배를 통해 유전적 다양성을 잃고 무너져가는 과정을 빗댄 것이죠.

합성 데이터를 둘러싼 잠재적 위험은 또 있습니다. 데이터에 존재하는 편향성을 중화시키기는커녕 증폭시킬 수 있다는 점이죠. 합성데이터를 활용한 AI 모델에서 기존 데이터의 편향이 그대로 복제되거나 오히려 강화될 수 있다는 겁니다. 파이낸셜타임스(FT)는 “빅테크들이 사람이 만든 데이터를 얻기 위해 수많은 자금을 투자하는 이유”라고 평했습니다.

데이터 고갈은 불가피…최적의 데이터 배합 찾아야

이러한 위험성에도 불구하고, 합성 데이터는 AI 개발에서 중요한 도구로 남을 것으로 보입니다. AI 업계 전문가들은 합성 데이터의 위험을 인식하면서도 그 활용 가치를 부정하지는 않고 있죠. 실제 데이터와 합성 데이터를 적절히 혼합하고, 합성 데이터의 생성 과정과 품질을 엄격히 관리하는 것이 중요하다는 겁니다.

앞서 언급한 옥스포드대 연구진의 논문에서도 이와 비슷한 내용을 찾아볼 수 있습니다. 합성 데이터에 인간이 생성한 데이터를 조금 섞었더니, AI 모델 붕괴가 발생하는 비율이 줄어들었다는 겁니다. 인간 데이터를 10%만 포함해도 모델 붕괴는 크게 더뎌졌다고 합니다.

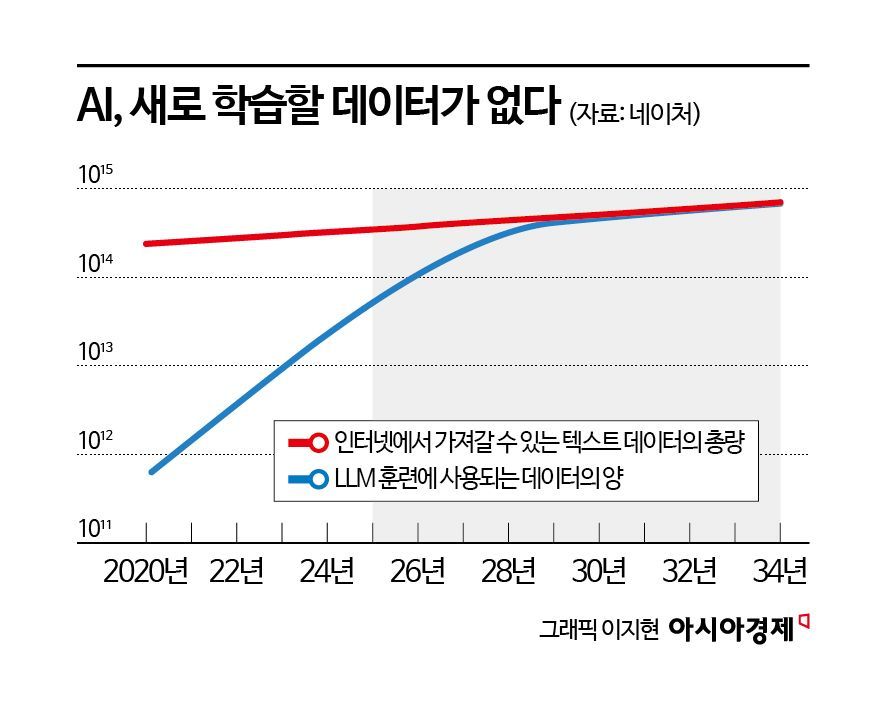

더군다나 인간이 생성하는 데이터의 양이 점차 고갈되고 있다는 현실도 무시할 수 없습니다. 오픈AI 공동창업자 일리야 수츠케버는 지난해 캐나다 벤쿠버에서 열린 한 강연에서 AI 모델 학습을 위한 데이터를 “유한한 화석연료”에 비유하면서 “현재 AI의 성능 향상에 도움이 될 만한 인터넷 데이터는 이미 바닥을 드러냈다”고 주장했습니다.

‘AI 유전병’이 무섭다는 이유로, 합성 데이터를 무조건 금기시해선 안 되는 상황인 것이죠. 인간이 만든 실제 데이터를 완전히 대체할 수 없는 합성 데이터의 한계를 명확히 인식하고, 그 위험성과 가능성을 균형 있게 바라보는 관점이 필요한 때입니다.

김동표 기자 letmein@asiae.co.kr<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

- #실제

- #합성

- #합스부르크

- #노트

- #데이터

- #학습

- #모델

- #오답

- #유전병

- #생성

- 기뻐요

- 0

- 응원해요

- 0

- 실망이에요

- 0

- 슬퍼요

- 0

- 1

- GS25 바삭 김밥의 화려한 귀환…입소문 타고 50만개 '완판'

- 아시아경제

0

0

- 2

- 스위트스팟, 식음료 할인·증정 서비스 ‘팝가 성수패스’ 출시

- 아시아경제

0

0

- 3

- 엔비디아, 오픈AI까지 총출동…韓 'AI 글로벌 컨퍼런스' 열린다

- 아시아경제

0

0

- 4

- 美 반도체 4강 '인텔·엔비디아·AMD·브로드컴' CEO 모두 중국계

- EBN뉴스센터

0

0

- 5

- 한화세미텍, SK에 HBM용 TC본더 납품…'엔비디아 공급체인' 합류

- EBN뉴스센터

0

0

- 6

- 한 달 만에 30억원어치 팔렸다…15000원짜리 중국산 이어폰 美서 불티

- 아시아경제

0

0

- 7

- 이재웅 쏘카 창업주, 17만주 공개매수…"주주에게 투자 회수 기회 제공"

- EBN뉴스센터

0

0

- 8

- 국내 2위 현대제철, 포항공장 희망퇴직·전환배치 약 90명 신청

- 아시아경제

0

0

- 9

- 글로벌 팬덤 솔루션 '비스테이지'…가수 권진아 멤버십 모집

- 아시아경제

0

0

- 10

- 기보, 우리은행·하나은행과 8100억 협약보증 공급

- 아시아경제

0

0

- 최신뉴스

- 인기뉴스

- 뉴스

- 투표

- 게임

- 이벤트

5

5

최신순

추천순

답글순

등록된 댓글이 없습니다.